WISKUNDE IIA

LINEAIRE ALGEBRA

HOOFDSTUK 1: LINEAIRE VERGELIJKINGEN

1.1 SYSTEMEN VAN LINEAIRE VERGELIJKINGEN

Een LINEAIRE VERGELIJKING met variabelen 𝑥1 , … , 𝑥𝑛 is een vergelijking die kan worden geschreven als:

𝑎1 𝑥1 + 𝑎2 𝑥2 + ⋯ + 𝑎𝑛 𝑥𝑛 = 𝑏

Hierin zijn 𝑏 en 𝑎1 , … , 𝑎𝑛 reële of complexe getallen. 𝑛 is een positief geheel getal.

Een systeem van lineaire vergelijkingen (lineair systeem) is een verzameling van meerdere lineaire

vergelijkingen die bestaan uit de variabelen 𝑥1 , … , 𝑥𝑛 . Een oplossing van het systeem is een lijst (𝑠1 , 𝑠2 , … , 𝑠𝑛 )

van getallen die iedere vergelijking kloppend maakt wanneer de waardes 𝑠1 , … , 𝑠𝑛 worden ingevuld voor

𝑥1 , … , 𝑥𝑛 . De verzameling van alle mogelijke oplossingen noemen we de oplossingsverzameling. Wanneer 2

lineaire systemen dezelfde oplossingsverzameling hebben, dan zijn ze EQUIVALENT.

De oplossing van een systeem van een systeem bestaande uit 2 lineaire vergelijkingen met 2 variabelen is het

snijpunt van deze 2 lijnen. Het is ook mogelijk dat er 0 of oneindig veel snijpunten zijn. Wanneer een lineair

systeem geen oplossing heeft, dan is het INCONSISTENT. Wanneer een lineair systeem 1 of oneindig veel

oplossingen heeft, dan is het CONSISTENT.

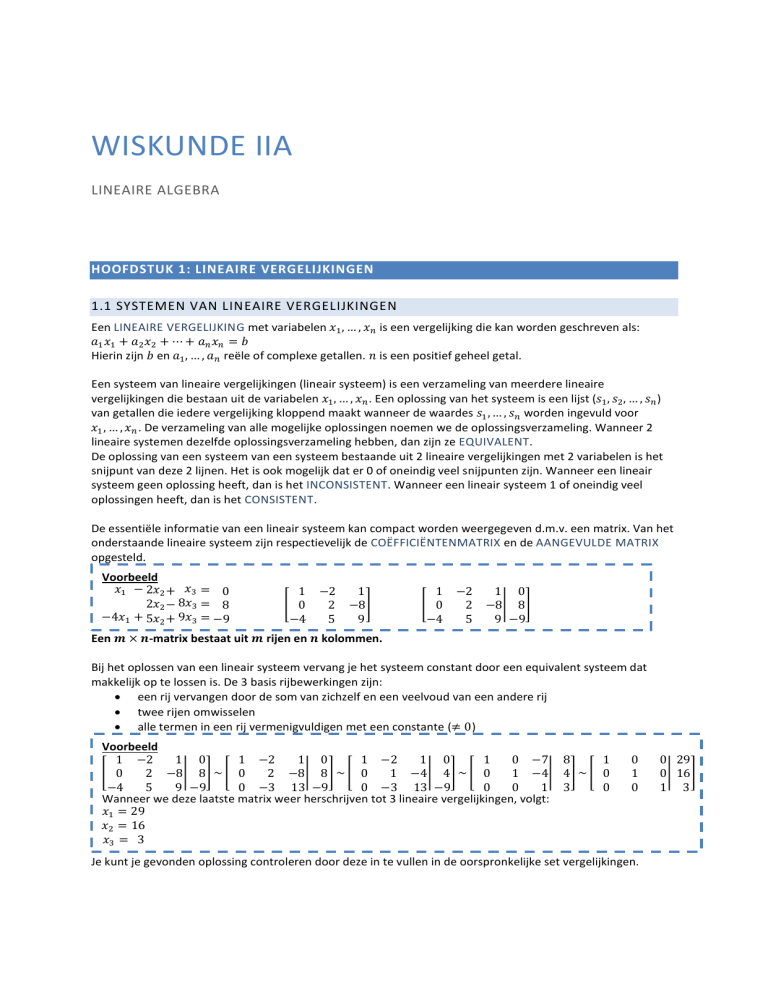

De essentiële informatie van een lineair systeem kan compact worden weergegeven d.m.v. een matrix. Van het

onderstaande lineaire systeem zijn respectievelijk de COËFFICIËNTENMATRIX en de AANGEVULDE MATRIX

opgesteld.

Voorbeeld

𝑥1 − 2𝑥2 + 𝑥3 = 0

2𝑥2 − 8𝑥3 = 8

−4𝑥1 + 5𝑥2 + 9𝑥3 = −9

1

[ 0

−4

−2

2

5

1

−8]

9

1

[ 0

−4

−2

2

5

1 0

−8| 8 ]

9 −9

Een 𝒎 × 𝒏-matrix bestaat uit 𝒎 rijen en 𝒏 kolommen.

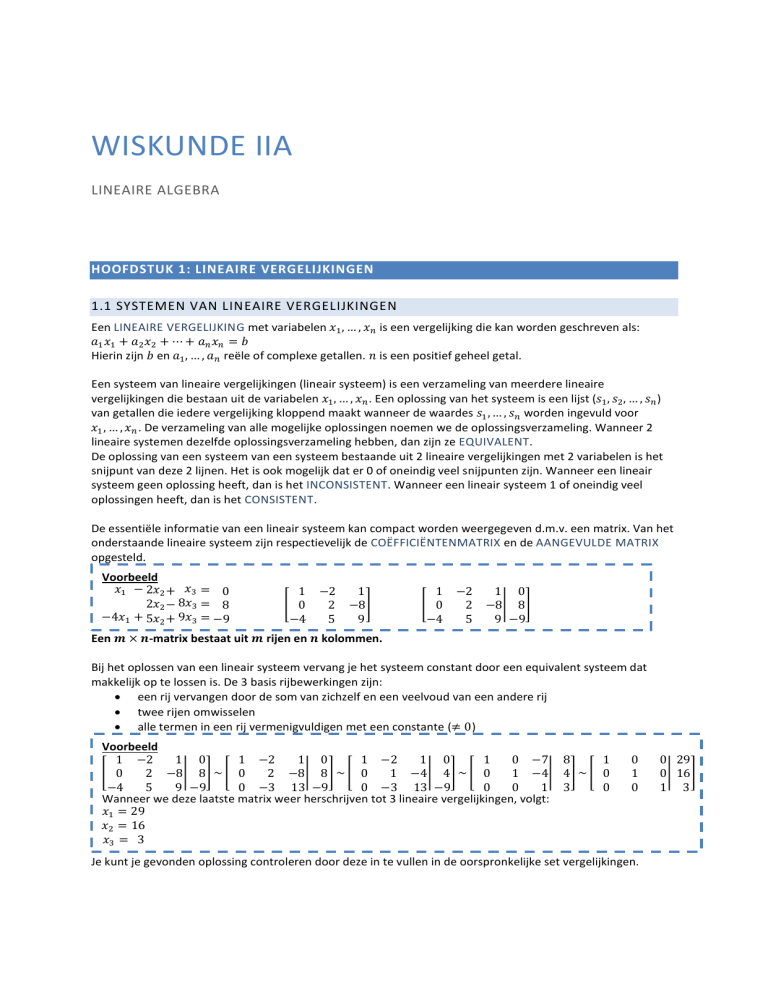

Bij het oplossen van een lineair systeem vervang je het systeem constant door een equivalent systeem dat

makkelijk op te lossen is. De 3 basis rijbewerkingen zijn:

een rij vervangen door de som van zichzelf en een veelvoud van een andere rij

twee rijen omwisselen

alle termen in een rij vermenigvuldigen met een constante (≠ 0)

Voorbeeld

1 −2

1 0

1 −2

1 0

1 −2

1 0

1

0 −7 8

1

[ 0

2 −8| 8 ] ~ [ 0

2 −8| 8 ] ~ [ 0

1 −4| 4 ] ~ [ 0

1 −4| 4] ~ [ 0

−4

5

9 −9

0 −3 13 −9

0 −3 13 −9

0

0

1 3

0

Wanneer we deze laatste matrix weer herschrijven tot 3 lineaire vergelijkingen, volgt:

𝑥1 = 29

𝑥2 = 16

𝑥3 = 3

0

1

0

Je kunt je gevonden oplossing controleren door deze in te vullen in de oorspronkelijke set vergelijkingen.

0 29

0| 16]

1 3

De matrices zijn RIJ-EQUIVALENT wanneer de ene matrix na een aantal rijbewerkingen hetzelfde is als de

andere matrix. Hieruit volgt dat beide matrices dezelfde oplossing hebben. Wanneer 2 matrices rij-equivalent

zijn, wordt dit genoteerd d.m.v. een ~.

1.2 RIJREDUCTIE EN ECHELONVORM

NIET-NUL RIJ / NIET-NUL KOLOM: een rij/kolom die ten minste één element bevat dat ongelijk aan nul is (∗)

HOOFDELEMENT (∎): het meest linker element in de rij dat ongelijk is aan nul

PIVOTPOSITIE: de posities waar de hoofdelementen zich bevinden wanneer een matrix in standaard- of

kanonieke rijvorm is geschreven

PIVOTKOLOM: een kolom die een pivot bevat

Een rechthoekige matrix is in de STANDAARD-RIJVORM (ECHELONVORM) wanneer het voldoet aan de

volgende eisen:

Alle niet-nul rijen staan boven de rijen met enkel nullen.

Elk hoofdelement in een rij zit in een kolom rechts van het hoofdelement van de bovenstaande

rij.

Alle elementen in een kolom onder een hoofdelement zijn nullen.

We spreken van een KANONIEKE RIJVORM wanneer de matrix ook voldoet aan de onderstaande eisen:

Het hoofdelement in elke niet-nul rij is één.

Elk hoofdelement is het enige niet-nul element in zijn kolom.

Elke matrix is rij-equivalent met slechts 1 matrix in kanonieke rijvorm. De pivotposities zijn in elke

(standaard-)rijvorm van een gegeven matrix hetzelfde.

∎

0

[

0

0

∗

∎

0

0

∗

∗

0

0

∗

∗

]

∎

0

1

0

[

0

0

0

1

0

0

∗

∗

0

0

0

0

]

1

0

In het voorbeeld in paragraaf 1.1 herschrijven we een matrix naar zijn kanonieke rijvorm. We kiezen telkens in

de meest linker niet-pivotkolom een pivot. D.m.v. een aantal rijbewerkingen maken we van deze kolom een

pivotkolom waarin de pivot een één is.

Hieronder staat het rijreductie algoritme beschreven. Dit is een soortgelijke manier om een matrix te

herschrijven naar zijn (kanonieke) rijvorm:

1. Kies de meest linker niet-nul kolom. Dit is de pivotkolom.

2. Kies een niet-nul element uit de pivotkolom als pivot. Indien nodig moet je rijen omwisselen om dit

element in pivotpositie te krijgen.

3. Creëer d.m.v. rijbewerkingen nullen in alle posities onder de pivot.

4. Negeer de rij met de net gekozen pivot (en alle rijen erboven) en pas stap 1 t/m 3 toe op de

overgebleven matrix totdat er geen niet-nul rijen over zijn.

5. Creëer, beginnende met de meest rechter pivot, nullen boven elke pivot. Wanneer een pivot geen één

is, maak het dan één door de rij te delen.

Wanneer we een aangevulde matrix hebben herschreven naar de kanonieke rijvorm, dan hebben we eigenlijk

de oplossing van het bijbehorende lineaire systeem.

Voorbeeld

1 0 −5 1

[0 1 1 | 4]

0 0 0 0

𝑥1

→

− 5𝑥3 = 1

𝑥2 + 𝑥 = 4

3

0 =0

→

𝑥1 = 1 + 5𝑥3

{𝑥2 = 4 − 𝑥3

𝑥3 𝑖𝑠 𝑣𝑟𝑖𝑗

Hierin komen de variabelen 𝑥1 en 𝑥2 overeen met de pivotkolommen in de matrix. Dit zijn de basisvariabelen.

De variabele 𝑥3 is een vrije variabele wat betekent dat je voor 𝑥3 iedere mogelijke waarde in zou mogen vullen.

Het is ook mogelijk om één van de andere variabelen als vrije variabele te kiezen en de andere variabelen in

deze variabele uit te drukken.

Wanneer een matrix is geschreven in standaard rijvorm, kan de oplossing verkregen worden d.m.v.

terugsubstitutie.

Voorbeeld

𝑥1 − 7𝑥2 + 2𝑥3 − 5𝑥4 = −9

1 −7

2 −5 −9

[0

→

𝑥2 − 3𝑥3 + 3𝑥4 = 15

1 −3

3 | 15]

− 𝑥3 + 𝑥4 = 4

0

0 −1

1 4

Uit de laatste uitdrukking volgt 𝑥3 = 𝑥4 − 4. Dit kunnen we invullen in de 2e vergelijking

waaruit een uitdrukking voor 𝑥2 volgt. Beide uitdrukkingen invullen in de 1e vergelijking

levert een uitdrukking voor 𝑥1 .

𝑥1 = 3𝑥4 + 20

𝑥 =3

{ 2

𝑥3 = 𝑥4 − 4

𝑥4 𝑖𝑠 𝑣𝑟𝑖𝑗

Een lineair systeem is consistent wanneer het in (standaard) rijvorm geen vergelijking in de vorm 𝟎 = 𝒃

bevat, oftewel, wanneer de laatste kolom van een aangevulde matrix geen pivotkolom is. Wanneer een

oplossing één of meer vrije variabelen bevat, dan zijn er oneindig veel oplossingen. Wanneer er geen vrije

variabelen zijn, dan is er een unieke oplossing.

1.3 VECTORVERGELIJKINGEN

Een (KOLOM)VECTOR is een geordende lijst getallen, oftewel een matrix bestaande uit 1 kolom. Een vector

𝑥1

[𝑥 ] kan ook geschreven worden als (𝑥1 , 𝑥2 ).

2

Om het verschil tussen een vector 𝒖 en een scalaire grootheid 𝑢 aan te geven, wordt de vector dikgedrukt of

wordt er een pijltje boven gezet (𝑢

⃗ ).

NULVECTOR (𝟎): vector waarvan alle elementen gelijk zijn aan 0

De verzameling van alle vectoren bestaande uit 𝑛 elementen wordt genoteerd als ℝ𝑛 (waarin 𝑛 een positief

geheel getal is). ℝ2 is dus de verzameling van alle vectoren bestaande uit 2 elementen.

De verzameling van alle vectoren bestaande uit 2 elementen wordt genoteerd als ℝ2 . Twee vectoren in ℝ2 zijn

enkel gelijk als hun corresponderende elementen allemaal gelijk zijn.

𝑎

Elk punt (𝑎, 𝑏) in een vlak kan worden vastgelegd d.m.v. de vector [ ]. ℝ2 is dus de verzameling van alle

𝑏

punten in dit vlak.

1

2

Rekenregels (waarbij 𝒖 = [ ], 𝒗 = [ ] en 𝑐 = 5):

−2

5

Optellen:

1+2

1

2

3

𝒖+𝒗= [ ]+[ ]= [

]=[ ]

−2 + 5

−2

5

3

Wanneer 𝒖 en 𝒗 punten in het vlak zijn, dan komt 𝑢 + 𝑣

overeen met het 4e hoekpunt van het parallellogram met

hoekpunten 𝑢, 0 en 𝑣.

Vermenigvuldigen met een scalair:

1

5

𝑐𝒖 = 5 [ ] = [

]

−2

−10

De verzameling van alle scalaire vermenigvuldigingen van een niet-nul vector is een lijn door de

oorsprong.

Algebraïsche eigenschappen van ℝ𝑛 :

𝒖+𝒗= 𝒗+𝒖

(𝒖 + 𝒗) + 𝒘 = 𝒖 + (𝒗 + 𝒘)

𝒖+𝟎=𝟎+𝒖=𝒖

𝒖 + (−𝒖) = −𝒖 + 𝒖 = 𝟎

𝑐(𝒖 + 𝒗) = 𝑐𝒖 + 𝑐𝒗

(𝑐 + 𝑑)𝒖 = 𝑐𝒖 + 𝑑𝒖

𝑐(𝑑𝒖) = (𝑐𝑑)(𝒖)

1𝒖 = 𝒖

LINEAIRE COMBINATIE: vector 𝒚 = 𝑐1 𝒗1 + 𝑐2 𝒗2 + ⋯ + 𝑐𝑝 𝒗𝑝 is de lineaire combinatie van de vectoren

𝒗1 , 𝒗2 , … , 𝒗𝑝 in ℝ𝑛 met gewicht 𝑐1 , 𝑐2 , … , 𝑐𝑝 .

Je kunt d.m.v. matrixbewerkingen bepalen of een vector een lineaire combinatie is van een aantal andere

vectoren of niet.

Voorbeeld

1

2

7

𝒂1 = [−2], 𝒂2 = [5] en 𝒃 = [ 4 ]. Wanneer 𝒃 een lineaire combinatie is van 𝒂1 en 𝒂2 , dan geldt 𝑥1 𝒂1 + 𝑥2 𝒂2 =

−3

−5

6

𝒃:

1

2

7

1

2 7

1

2 7

1

0 3

𝑥1 [−2] + 𝑥2 [5] = [ 4 ]

→

[−2

5| 4 ] ~ [ 0

9 | 18] ~ [ 0

1| 2]

−3

−5

6

−5

6 −3

0 16 32

0

0 0

Hieruit volgt dat 𝑏 een lineaire combinatie is van 𝑎1 en 𝑎2 wanneer 𝑥1 = 3 en 𝑥2 = 2.

Uit het bovenstaande voorbeeld volgt bovendien dat een vectorvergelijking 𝑥1 𝒂1 + 𝑥2 𝒂2 + ⋯ + 𝑥𝑛 𝒂𝑛 = 𝒃

dezelfde oplossingsverzameling heeft als de aangevulde matrix [𝒂1 𝒂2 … 𝒂𝑛 | 𝒃].. 𝒃 is een oplossing

van de lineaire combinatie van 𝒂1 , 𝒂2 , … , 𝒂𝑛 wanneer het lineaire systeem dat hoort bij de matrix een

oplossing heeft.

Wanneer 𝒗1 , 𝒗2 , … , 𝒗𝑝 in ℝ𝑛 zitten, dan noemen we de verzameling van alle lineaire combinaties van

𝒗1 , 𝒗2 , … , 𝒗𝑝 , genoteerd als 𝑆𝑝𝑎𝑛{𝒗1 , 𝒗2 , … , 𝒗𝑝 }, het OPSPANSEL van 𝒗1 , 𝒗2 , … , 𝒗𝑝 :

𝑆𝑝𝑎𝑛{𝒗1 , 𝒗2 , … , 𝒗𝑝 } = 𝑐1 𝒗1 + 𝑐2 𝒗2 + ⋯ + 𝑐𝑝 𝒗𝑝

Dit is een deelverzameling van ℝ𝑛 . De nulfactor behoort altijd tot 𝑆𝑝𝑎𝑛{𝒗1 , 𝒗2 , … , 𝒗𝑝 }.

Wanneer we willen weten of een vector 𝒃 in 𝑆𝑝𝑎𝑛{𝒗1 , 𝒗2 , … , 𝒗𝑝 } zit, dan vragen we ons eigenlijk af of 𝒃 een

lineaire combinatie is van 𝒗1 , 𝒗2 , … , 𝒗𝑝 .

Wanneer 𝒗 een niet-nul vector is in ℝ3 , dan vormt 𝑆𝑝𝑎𝑛{𝒗} een lijn door 𝒗 en 𝟎. Wanneer 𝒖 en 𝒗 niet-nul

vectoren zijn en 𝒗 geen veelvoud van 𝒖 is, dan vormt 𝑆𝑝𝑎𝑛{𝒖, 𝒗} een vlak dat 𝒖, 𝒗 en 𝟎 bevat.

1.4 DE MATRIXVERGELIJKING 𝐴𝒙 = 𝒃

Een lineaire combinatie van vectoren kan ook worden gezien als het product van een matrix en een vector.

Wanneer 𝐴 een 𝑚 × 𝑛 matrix met kolommen 𝒂1 , 𝒂2 , … , 𝒂𝑛 en 𝒙 een vector is in ℝ𝑛 , dan is het product van 𝐴

en 𝑥 de lineaire combinatie van de kolommen van 𝐴 waarbij de elementen van 𝒙 het gewicht van elke kolom

aangeven:

𝑥1

𝑥2

𝐴𝒙 = [𝒂1 𝒂2 … 𝒂𝑛 ] [ ⋮ ] = 𝑥1 𝒂1 + 𝑥2 𝒂2 + ⋯ + 𝑥𝑛 𝒂𝑛

𝑥𝑛

𝐴𝒙 bestaat alleen als het aantal kolommen van 𝐴 gelijk is aan het aantal elementen van 𝒙.

Voorbeeld

[

1

0

2

−5

4

−1

1

2

−1

4

6

−7

3

] [ 3] = 4 [ ] + 3 [ ] + 7 [ ] = [ ] + [

]+[ ]=[ ]

3

0

−5

3

0

−15

21

6

7

Wanneer 𝐴 een 𝑚 × 𝑛 matrix met kolommen 𝒂1 , 𝒂2 , … , 𝒂𝑛 en 𝒃 een vector is in ℝ𝑛 , dan heeft de

matrixvergelijking 𝐴𝒙 = 𝒃 dezelfde oplossingsverzameling als de vectorvergelijking 𝑥1 𝒂1 + 𝑥2 𝒂2 + ⋯ +

𝑥𝑛 𝒂𝑛 = 𝒃, wat dezelfde oplossingsverzameling heeft als het systeem van lineaire vergelijkingen waarvan de

aangevulde matrix is [𝒂1 𝒂2 … 𝒂𝑛 | 𝒃].

Oftewel: elk systeem van lineaire vergelijkingen en iedere vectorvergelijking kan worden geschreven als een

matrixvergelijking in de vorm 𝐴𝒙 = 𝒃.

Op basis van het bovenstaande en de vorige paragraaf kan gesteld worden dat de vergelijking 𝐴𝒙 = 𝒃 dan en

slechts dan een oplossing heeft als 𝒃 een lineaire combinatie is van de kolommen van A.

De vergelijking 𝐴𝒙 = 𝒃 is consistent voor elke 𝒃 wanneer de 𝑚 × 𝑛 matrix 𝐴 in standaard rijvorm een pivot

heeft in elke rij. Het maakt dan niet uit wat er gebeurt in de laatste rij van de aangevulde matrix

[𝒂1 𝒂2 … 𝒂𝑛 | 𝒃], omdat er geen rij kan ontstaan als [0 0 0 0 | 1]. Er kan geen pivot zijn in de

laatste rij van de aangevulde matrix.

Wanneer 𝐴𝒙 = 𝒃 consistent is voor elke 𝒃 in ℝ𝒎 , is elke 𝒃 een lineaire combinatie van de kolommen van 𝐴 en

spannen de kolommen van 𝐴 ℝ𝑚 op: 𝑆𝑝𝑎𝑛{𝒂1 , 𝒂2 , … , 𝒂𝑛 } = ℝ𝑚

In het begin van deze paragraaf hebben het product van een matrix en een vector berekend. Dit kan op een

simpelere manier. Het 𝑖 de element van 𝐴𝒙 is de som van de producten van de elementen uit de 𝑖 de rij van

matrix 𝐴 en de bijbehorende elementen uit 𝒙.

Voorbeeld

[

1

0

2

−5

4

1 ∙ 4 + 2 ∙ 3 + (−1) ∙ 7

−1

3

] [ 3] = [

]=[ ]

0 ∙ 4 + (−5) ∙ 3 + 3 ∙ 7

3

6

7

IDENTITEITSMATRIX (𝐼): matrix met 1’en op de diagonaal en verder enkel 0’en. Wanneer je een vector (of een

matrix) vermenigvuldigt met de eenheidsmatrix, is de uitkomst de oorspronkelijke vector (of matrix):

𝑥1

1 ∙ 𝑥1 + 0 ∙ 𝑥2 + 0 ∙ 𝑥3

1 0 0

1 0 0 𝑥1

𝐼 = [0 1 0]

→

𝐼𝒙 = [0 1 0] [𝑥2 ] = [0 ∙ 𝑥1 + 1 ∙ 𝑥2 + 0 ∙ 𝑥3 ] = [𝑥2 ] = 𝒙

𝑥3

0 ∙ 𝑥1 + 0 ∙ 𝑥2 + 1 ∙ 𝑥3

0 0 1

0 0 1 𝑥3

Algebraïsche eigenschappen van ℝ𝑛 :

𝐴(𝒖 + 𝒗) = 𝐴𝒖 + 𝐴𝒗

𝐴(𝑐𝒖) = 𝑐(𝐴𝒖)

1.5 OPLOSSINGSVERZAMELINGEN VAN LINEAIRE SYSTEMEN

HOMOGEEN LINEAIR SYSTEEM: een systeem van lineaire vergelijkingen dat kan worden geschreven in de

vorm 𝐴𝒙 = 0.

Een homogeen lineair systeem heeft altijd ten minste één oplossing, namelijk 𝒙 = 0. Deze oplossing noemen

we de TRIVIALE OPLOSSING. Het systeem heeft ook een niet-triviale oplossing dan en slechts dan als de

vergelijking ten minste één vrije variabele bevat.

Voorbeeld

3𝑥1 + 5𝑥2 − 4𝑥3 = 0

−3𝑥1 − 2𝑥2 + 4𝑥3 = 0

→

6𝑥1 +

𝑥2 − 8𝑥3 = 0

4

3

5 −4 0

3

5 −4 0

1

0 − 0

3

[−3 −2

→

4 | 0] ~ [ 0

3

0 | 0] ~ [ 0

1

0 | 0]

0

6

1 −8 0

0 −9

0 0

0

0

0

4

4

4

𝑥1

𝑥3

3

3

3

𝒙 = [𝑥2 ] = [ 0 ] = 𝑥3 [0] = 𝑥3 𝒗 , waarbij 𝒗 = [0]

𝑥3

𝑥3

1

1

Het homogene systeem heeft een nontriviale oplossing. De oplossingsverzameling is een

lijn door 𝟎 en 𝒗, aangezien elke oplossing een scalaire vermenigvuldiging is van 𝒗.

Voorbeeld

10𝑥1 − 3𝑥2 − 2𝑥3 = 0 →

𝑥1

0,3𝑥2 + 0,2𝑥3

0,3

0,3

0,2

0,2

𝑥

𝑥2

𝒙 = [ 2] = [

] = 𝑥2 [ 1 ] + 𝑥3 [ 0 ] = 𝑥2 𝒗1 + 𝑥3 𝒗2 , waarbij 𝒗1 = [ 1 ] en 𝒗2 = [ 0 ]

𝑥3

𝑥3

0

1

0

1

Het homogene systeem heeft een nontriviale oplossing. De oplossingsverzameling is een vlak door 𝟎,

𝒖 en 𝒗, aangezien elke oplossing een lineaire combinatie is van 𝒗1 en 𝒗2 .

De bovenstaande voorbeelden laten zien dat de oplossingsverzameling van een homogene vergelijking 𝐴𝒙 = 𝟎

altijd kan worden uitgedrukt als 𝑆𝑝𝑎𝑛{𝒗1 , 𝒗2 , … , 𝒗𝑝 }. Wanneer er enkel een triviale oplossing is, dan kan de

oplossingsverzameling worden geschreven als 𝑆𝑝𝑎𝑛{𝟎}. Het aantal vectoren waaruit het opspansel bestaat, is

afhankelijk van het aantal vrije variabelen.

De originele vergelijking voor het vlak in het 2e voorbeeld is een impliciete beschrijving van een vlak. De

oplossing is een expliciete beschrijving. We spreken van een parametrische vectorvorm (𝒙 = 𝑠𝒖 + 𝑡𝒗).

Ook de algemene oplossing van een niet-homogeen lineair systeem kan worden geschreven in parametrische

vectorvorm als een vector plus een willekeurige lineaire combinatie van vectoren die voldoen aan het

betreffende homogene systeem. Wanneer er één vrije variabele is, dan is de oplossing in de vorm 𝒙 = 𝒑 + 𝑡𝒗.

Deze vergelijking weergeeft een lijn door 𝒑 parallel aan 𝒗. In het algemeen geldt dat de oplossingsverzameling

van 𝐴𝒙 = 𝒃 de verzameling van alle vectoren in de vorm 𝒘 = 𝒑 + 𝒗ℎ is, waarin 𝒑 een willekeurig oplossing van

de (inhomogene) vergelijking en 𝒗ℎ een oplossing van de homogene vergelijking 𝐴𝒙 = 𝟎 is.

1.6 TOEPASSINGEN VAN LINEAIRE SYSTEMEN

IN EVENWICHT BRENGEN VAN CHEMISCHE REACTIES

Voorbeeld

(𝑥1 )𝐶3 𝐻8 + (𝑥2 )𝑂2 → (𝑥3 )𝐶𝑂2 + (𝑥4 )𝐻2 𝑂

→

3

0

0

−1

0

𝑥1 [8] + 𝑥2 [0] + 𝑥3 [ 0 ] + 𝑥4 [−2] = [0]

0

2

−2

−1

0

→

3

[8

0

1

0 0

−2 | 0] ~ [0

−1 0

0

0 −1

0

0

2 −2

0

0

2

−

1

3

8

3

−2

0

𝑥

4 4

5

𝑥

4 4

1

−2 | 0] ~ 0

−1 0 [0

1

𝑥1

𝑥2

𝒙 = [𝑥 ] =

3

𝑥4

0

0

1

0

3

0

1

0 ← 𝐾𝑜𝑜𝑙𝑠𝑡𝑜𝑓

𝑥1 [8] + 𝑥2 [0] = 𝑥3 [0] + 𝑥4 [2] ← 𝑊𝑎𝑡𝑒𝑟𝑠𝑡𝑜𝑓

0

2

2

1 ← 𝑍𝑢𝑢𝑟𝑠𝑡𝑜𝑓

−

1

3

−1

8

3

0

0

0

− || 0 ~ 0

2

1

0

0

|

− |0

4

−2 0]

0

1

−

1

[0

−

1

1

0

4

5

3

4

0]

1

5

= 𝑥4 [ ]

4

3

4

1

→

𝑥4

4

[ 𝑥4 ]

Aangezien de coëfficiënten gehele getallen moeten zijn, kiezen we 𝑥4 = 4:

𝐶3 𝐻8 + 5𝑂2 → 3𝐶𝑂2 + 4𝐻2 𝑂

3

STROMING DOOR EEN NETWERK

Een netwerk bestaat uit een verzameling (knoop)punten en pijlen (takken) tussen een aantal van de punten. De

basisaanname van de stroming van een netwerk is dat de totale stroom die het netwerk binnenkomt gelijk is

aan de totale stroom die het netwerk uitstroomt, en dat de stroom die een knooppunt binnenkomt gelijk is aan

de stroom die een knooppunt uitstroomt. Op basis van deze aanname kun je voor elk knooppunt een lineaire

vergelijking opstellen en vervolgens dit lineaire systeem oplossen.

1.7 LINEAIRE ONAFHANKELIJKHEID

Een verzameling vectoren {𝒗1 , 𝒗2 , … , 𝒗𝑝 } in ℝ𝑛 is LINEAIR ONAFHANKELIJK wanneer de vergelijking 𝑥1 𝒗1 +

𝑥2 𝒗2 + ⋯ + 𝑥𝑝 𝒗𝑝 = 𝟎 enkel een triviale oplossing heeft. Voor matrixen geldt een soortgelijke regel. De

kolommen van een matrix 𝐴 zijn lineair onafhankelijk dan en slechts dan als de vergelijking 𝐴𝒙 = 𝟎 alleen een

triviale oplossing heeft.

Een verzameling vectoren {𝒗1 , 𝒗2 , … , 𝒗𝑝 } in ℝ𝑛 is LINEAIR AFHANKELIJK wanneer er gewichten 𝑐1 , 𝑐2 , … 𝑐𝑝

bestaan (niet allemaal gelijk aan 0) waarvoor geldt: 𝑐1 𝒗1 + 𝑐2 𝒗2 + ⋯ + 𝑐𝑝 𝒗𝑝 = 𝟎.

Voorbeeld

1

4

2

𝒗1 = [2], 𝒗2 = [5] en 𝒗3 = [1]

6

3

0

Herschrijven tot de (aangevulde) matrix van een lineair homogeen systeem:

𝑥1

2𝑥3

1 4 2 0

1

4

2 0

1

0 −2 0

2

[ 2 5 1 | 0] ~ [ 0 −3 −3 | 0] ~ [ 0

→

𝒙 = [𝑥2 ] = [−𝑥3 ] = 𝑥3 [−1]

1

1 | 0]

𝑥3

𝑥3

3 6 0 0

0 −6 −6 0

0

0

0 0

1

Er is een vrije variabele, dus de vectoren 𝒗1 , 𝒗2 en 𝒗3 zijn lineair afhankelijk. Elke 𝑥3 ongelijk aan 0 geeft een

lineair afhankelijke relatie tussen 𝒗1 , 𝒗2 en 𝒗3 .

Een verzameling bestaande uit 1 vector 𝒗 is lineair onafhankelijk dan en slechts dan als 𝒗 geen nulvector is,

aangezien de vectorvergelijking 𝑥1 𝒗 = 𝟎 dan alleen de triviale oplossing heeft. De nulvector is lineair

afhankelijk, omdat 𝑥1 𝟎 = 𝟎 vele niet-triviale oplossingen heeft.

Een verzameling bestaande uit 2 vectoren is lineair afhankelijk dan en slechts dan als ten minste 1 van de

vectoren een veelvoud is van de ander.

Een verzameling in ℝ𝑛 bestaande uit meer dan 2 vectoren 𝑆 = {𝒗1 , 𝒗2 , … , 𝒗𝑝 } is lineair afhankelijk dan en

slechts dan als ten minste één van de vectoren een lineaire combinatie is van de andere vectoren. Wanneer de

verzameling meer vectoren dan elementen bevat (𝑝 > 𝑛), dan is de verzameling altijd lineair afhankelijk. Er zijn

dan namelijk meer variabelen dan vergelijkingen, waardoor er ten minste één vrije variabele moet zijn en 𝐴𝒙 =

𝟎 een niet-triviale oplossing heeft. De verzameling is ook lineair afhankelijk wanneer hij de nulvector bevat.

1.8 INTRODUCTIE TOT LINEAIRE TRANSFORMAT IES

Het oplossen van de vergelijking 𝐴𝒙 = 𝒃 kan worden gezien als het vinden van alle vectoren 𝒙 in ℝ𝑛 die

worden getransformeerd naar de vector 𝒃 in ℝ𝑚 bij vermenigvuldiging met de 𝑚 × 𝑛 matrix 𝐴 (𝒙 ↦ 𝐴𝒙).

Een TRANSFORMATIE 𝑇 van ℝ𝑛 naar ℝ𝑚 (𝑇: ℝ𝑛 → ℝ𝑚 ) is een regel die elke (𝑛 × 1) vector 𝒙 in ℝ𝑛 verbindt

aan een (𝑚 × 1) vector 𝑇(𝒙) in ℝ𝑚 . De verzameling ℝ𝑛 is het DOMEIN van 𝑇, ℝ𝑚 het CODOMEIN. De vector

𝑇(𝒙) noemen we de AFBEELDING van 𝒙. De verzameling van alle afbeeldingen 𝑇(𝒙) noemen we het BEREIK

van 𝑇. Dit is de verzameling van alle lineaire combinaties van de kolommen van 𝐴.

Voorbeeld

1 0 0

𝐴 = [0 1 0]

0 0 0

𝒙 ↦ 𝐴𝒙 :

𝑥1

𝑥1

1 0 0 𝑥1

𝑥

𝑥

𝑥

[ 2 ] ⟼ [0 1 0] [ 2 ] = [ 2 ]

𝑥3

0

0 0 0 𝑥3

Deze transformatie projecteert punten in ℝ3 op het 𝑥1 𝑥2 -vlak.

Voorbeeld

1 3

𝐴=[

]

0 1

Wanneer je alle punten binnen het vierkant met hoekcoördinaten (0, 0), (2, 0), (2, 2) en (0, 2) transformeert

volgens 𝒙 ↦ 𝐴𝒙, dan levert dit een parallellogram met hoekcoördinaten (0, 0), (2, 0), (8, 2) en (6, 2). We

noemen dit een afschuiftransformatie.

Voorbeeld

𝑇: ℝ2 → ℝ2

−𝑥2

0 −1 𝑥1

𝑇(𝒙) = [

][ ] = [ 𝑥 ]

1

0 𝑥2

1

4

0 −1 4

−1

𝒖=[ ]

→

𝑇(𝒖) = [

][ ] = [ ]

1

1

0 1

4

2

0 −1 2

−3

𝒗=[ ]

→

𝑇(𝒖) = [

][ ] = [ ]

3

1

0 3

2

o

Transformatie 𝑇 roteert alle punten 𝒙 90 tegen de klok in.

Een transformatie is lineair wanneer geldt:

𝑇(𝒖 + 𝒗) = 𝑇(𝒖) + 𝑇(𝒗)

voor alle 𝒖, 𝒗 in het domein van 𝑇

𝑇(𝑐𝒖) = 𝑐𝑇(𝒖)

voor alle 𝑐 en alle 𝒖 in het domein van 𝑇

Uit de bovenstaande regels volgt ook dat wanneer 𝑇 een lineaire transformatie is, dat dan geldt:

𝑇(𝟎) = 𝟎

𝑇(𝑐𝒖 + 𝑑𝒗) = 𝑐𝑇(𝒖) + 𝑑𝑇(𝒗)

𝑇(𝑐1 𝒗1 + 𝑐2 𝒗2 + ⋯ + 𝑐𝑝 𝒗𝑝 ) = 𝑐1 𝑇(𝒗1 ) + 𝑐2 𝑇(𝒗2 ) + ⋯ + 𝑐𝑝 𝑇(𝒗𝑝 ) ← superpositieprincipe

Elke matrixtransformatie (𝒙 ↦ 𝐴𝒙) is een lineaire transformatie. Andere vormen van lineaire transformaties

kom hier nu niet aan de orde.

1.9 DE MATRIX VAN EEN LINEAIRE TRANSFORMATIE

Wanneer voor een bepaalde matrixtransformatie (𝒙 ↦ 𝐴𝒙) 𝒙 en 𝑇(𝒙) voor een aantal punten bekend zijn, kan

𝐴 bepaald worden. De sleutel tot het vinden van 𝐴 is het opmerken dat 𝑇 volledig bepaald is door wat het doet

met de kolommen van de identiteitsmatrix 𝐼𝑛 .

Voorbeeld

−3

5

𝑇(𝒆1 ) = [−7] en 𝑇(𝒆2 ) = [ 8 ]

0

2

𝑥1

1

0

𝒙 = [𝑥 ] = 𝑥1 [ ] + 𝑥2 [ ] = 𝑥1 𝒆1 + 𝑥2 𝒆2

→

2

0

1

−3

5

𝑇(𝒙) = 𝑥1 𝑇(𝒆1 ) + 𝑥2 𝑇(𝒆2 ) = 𝑥1 [−7] + 𝑥2 [ 8 ] = 𝐴𝒙

0

2

→

5

𝐴 = [−7

2

−3

8 ] = [𝑇(𝑒1 )

0

Uit het bovenstaande voorbeeld volgt de volgende theorie:

Wanneer 𝑇: ℝ𝑛 → ℝ𝑚 een lineaire transformatie is, dan is er een unieke matrix 𝐴 waarvoor geldt:

𝑇(𝒙) = 𝐴𝒙

voor alle 𝒙 in ℝ𝑛 , waarin 𝐴 = [𝑇(𝒆1 ) 𝑇(𝒆2 ) … 𝑇(𝒆𝑛 )]

We noemen deze matrix de standaard matrix voor de lineaire transformatie 𝑇.

𝑇(𝑒2 )]

Voorbeeld

𝑇: ℝ2 → ℝ2 is de transformatie die elk punt in ℝ2 met een hoek 𝜑 tegen de klok in om de oorsprong draait.

Hieruit volgt:

cos 𝜑

− sin 𝜑

𝑇(𝒆1 ) = [ sin 𝜑 ] en 𝑇(𝒆2 ) = [

]

cos 𝜑

cos 𝜑 − sin 𝜑

𝐴 = [𝑇(𝑒1 ) 𝑇(𝑒2 )] = [

]

sin 𝜑

cos 𝜑

Zie blz. 73 t/m 75 voor een aantal standaardmatrices bij bepaalde transformaties.

We noemen een transformatie 𝑇: ℝ𝑛 → ℝ𝑚 SURJECTIEF (‘onto’) wanneer elke 𝒃 in ℝ𝑚 een afbeelding is van

ten minste één 𝒙 in ℝ𝑛 . Dit is het geval wanneer het bereik van 𝑇 het hele codomein ℝ𝑚 beslaat.

We noemen een transformatie 𝑇: ℝ𝑛 → ℝ𝑚 INJECTIEF (‘one to one’) wanneer elke 𝒃 in ℝ𝑚 een afbeelding is

van hooguit één 𝒙 in ℝ𝑛 . Dit is het geval dan en slechts dan als de vergelijking 𝑇(𝒙) = 𝟎 enkel een triviale

oplossing heeft.

Wanneer 𝑇: ℝ𝑛 → ℝ𝑚 een lineaire transformatie is met 𝐴 als standaardmatrix, dan geldt:

𝑇 is surjectief dan en slechts dan als de kolommen van 𝐴 ℝ𝑚 opspannen (geen nulrij).

𝑇 is injectief dan en slechts dan als de kolommen van 𝐴 lineair onafhankelijk zijn (geen vrije

variabelen).

Voorbeeld

𝑥1

𝒙 = [𝑥 ]

2

3𝑥1 + 𝑥2

3 1

𝑇(𝒙) = [ 5𝑥1 + 7𝑥2 ] = 𝐴𝒙

→

𝐴 = [5 7]

𝑥1 + 3𝑥2

1 3

De kolommen van 𝐴 zijn lineair onafhankelijk, dus 𝑇(𝒙) is injectief. De kolommen van 𝐴 spannen ℝ2 op.

Omdat 𝑇: ℝ2 → ℝ3 , is 𝑇(𝒙) dan en slechts dan surjectief als de kolommen van 𝐴 ℝ3 opspannen. 𝑇(𝒙) is

dus niet surjectief.

1.10 LINEAIRE MODELLEN IN DE HANDEL, DE WETENSCHAP EN DE TECHNIEK

STROOMKRING

Wanneer de stroom langs een weerstand loopt, dan wordt een deel van

het spanning ‘opgebruikt’. Hiervoor geldt:

𝑉 = 𝑅𝐼

We kunnen een parallelle stroomkring onderverdelen in een aantal lussen.

In elke lus geldt dat de som van de daling van het voltage als gevolg van de

weerstanden gelijk moet zijn aan de som van de spanningsbronnen. Op

basis van dit gegeven kan een lineair systeem worden opgesteld. De

spanning is positief wanneer de stroom van de lange kant door de

stroomkring naar de korte kant loopt.

Voorbeeld

Bovenste lus:

𝑉 = 3𝐼1 + 4𝐼1 + 4𝐼1 − 3𝐼2 = 30

Middelste lus: 𝑉 = 1𝐼2 + 1𝐼2 + 3𝐼2 + 1𝐼2 − 3𝐼1 − 1𝐼3 = 5

Onderste lus:

𝑉 = 1𝐼3 + 1𝐼3 + 1𝐼3 − 1𝐼2 = −5 − 20

Dit levert de volgende aangevulde matrix:

5

1

−

1 −2

1

0

11 −3

0 30

3

3

11

145

[ −3

]~[ 0

6 −1| 5 ] ~ [ 0 19 − |

1

3

3

0 −1

3 −25

0

0

0 −1

3 −25

𝐼1 = 3𝐴

𝐼2 = 1𝐴

𝐼3 = −8𝐴

11𝐼1 − 3𝐼2 = 30

−3𝐼1 + 6𝐼2 − 𝐼3 = 5

−𝐼2 + 3𝐼3 = −25

→

→

→

−

17

3

−3 |

160

3

145

1

3

25 ] ~ [ 0

1280

0

−

3

0

1

0

0 3

0 | 1]

1 −8

DIFFERENTIEVERGELIJKING

Een lineaire differentievergelijking is een vergelijking in de vorm:

𝒙𝑘+1 = 𝐴𝒙𝑘

Wanneer 𝒙0 bekend is, kun je gemakkelijk 𝒙1 , 𝒙2 enz. bepalen door te herhaaldelijk te vermenigvuldigen met

matrix 𝐴.

Voorbeeld

Voor de verplaatsing van populaties kan een differentievergelijking worden opgesteld. In het

beginjaar geldt:

𝑟0

600.000

𝑥0 = [𝑠 ] = [

]

0

400.000

Hierin staat 𝑟 voor de populatie in de stad en 𝑠 voor de populatie buiten de stad.

Verder is bekend dat na 1 jaar 5% van de bevolking van de stad verhuisd is naar buiten de stad, en

dat 3% van de bevolking van buiten de stad naar de stad is verhuisd. Hieruit volgt:

𝑟1

0,03

0,95

0,95 0,03 𝑟0

[𝑠 ] = [

] 𝑟0 + [

] 𝑠0 = [

][ ]

0,97

0,05

0,05 0,97 𝑠0

1

0,95 0,03

𝑥𝑘+1 = 𝑀𝑥𝑘 , waarin 𝑀 = [

] (migratiematrix)

0,05 0,97

0,95 0,03 600.000

582.000

𝑥1 = 𝑀𝑥0 = [

][

]=[

]

0,05 0,97 400.000

418.000

0,95 0,03 582.000

565.440

𝑥2 = 𝑀𝑥1 = [

][

]=[

]

0,05 0,97 418.000

434.560

enz.

HOOFDSTUK 2: MATRIX ALGEBRA

2.1. MATRIXBEWERKINGEN

Wanneer 𝐴 een 𝑚 × 𝑛 matrix is, een matrix met 𝑚 rijen en 𝑛 kolommen, dan noteren we het element in de 𝑖 𝑑𝑒

rij en 𝑗 𝑑𝑒 kolom als 𝑎𝑖𝑗 . Elke kolom staat voor een lijst van 𝑚 reële getallen, oftewel, een vector in ℝ𝑚 .

𝑎11 ⋯ 𝑎1𝑗 ⋯ 𝑎1𝑛

⋮

⋮

⋮

𝐴 = 𝑎𝑖1 ⋯ 𝑎𝑖𝑗 ⋯ 𝑎𝑖𝑛 = [𝒂1 𝒂2 … 𝒂𝑛 ]

⋮

⋮

⋮

[𝑎𝑚1 ⋯ 𝑎𝑚𝑗 ⋯ 𝑎𝑚𝑛 ]

De diagonale elementen in de bovenstaande matrix (𝑎11 , 𝑎22 , 𝑎33 , enz.) vormen de HOOFDDIAGONAAL. Een

DRIEHOEKIGE MATRIX is een vierkante matrix waarin alle niet-diagonale elementen gelijk zijn aan 0. Wanneer

alle elementen gelijk zijn aan 0, spreken we over een NULMATRIX.

Twee matrices zijn gelijk wanneer ze dezelfde grootte hebben, oftewel hetzelfde aantal rijen en kolommen.

Matrices kunnen enkel bij elkaar worden opgeteld als ze gelijk zijn. De som van 2 matrices is de matrix met als

elementen de sommen van de bijbehorende elementen van de 2 matrices. Dit is vergelijkbaar met het optellen

van vectoren.

𝑎11 𝑎12 𝑎13

𝑏11 𝑏12 𝑏13

𝑎 + 𝑏11 𝑎12 + 𝑏12 𝑎13 + 𝑏13

𝐴 = [𝑎

→

𝐴 + 𝐵 = [ 11

]

𝑎23 ] en 𝐵 = [𝑏21 𝑏22 𝑏23 ]

𝑎21 + 𝑏21 𝑎22 + 𝑏22 𝑎23 + 𝑏23

21 𝑎22

Het vermenigvuldigen met een scalair is ook vergelijkbaar met vectoren:

𝑐𝑏

𝑐𝑏12 𝑐𝑏13

𝑐𝐵 = [ 11

]

𝑐𝑏21 𝑐𝑏22 𝑐𝑏23

Verder gelden de algebraïsche eigenschappen:

𝐴+𝐵 =𝐵+𝐴

𝑟(𝐴 + 𝐵) = 𝑟𝐴 + 𝑟𝐵

(𝐴 + 𝐵) + 𝐶 = 𝐴 + (𝐵 + 𝐶)

(𝑟 + 𝑠)𝐴 = 𝑟𝐴 + 𝑠𝐴

𝐴+0=𝐴

𝑟(𝑠𝐴) = (𝑟𝑠)𝐴

In paragrafen 1.8 en 1.9 hebben we een vector 𝒙 vermenigvuldigd met een matrix 𝐴. We kunnen ook 2

matrices met elkaar vermenigvuldigen, maar alleen wanneer matrix 𝐴 𝑚 × 𝑛 matrix is en matrix 𝐵 een 𝑛 × 𝑝

matrix. Er geldt dan:

𝐴𝐵 = 𝐴[𝒃1 𝒃2 … 𝒃𝑝 ] = [𝐴𝒃1 𝐴𝒃2 … 𝐴𝒃𝑝 ]

𝐴𝐵 heeft evenveel rijen als 𝐴 en evenveel kolommen als 𝐵.

Elke kolom van 𝑨𝑩 is een lineaire combinatie van de kolommen van 𝑨 met gewichten uit de bijbehorende

kolom van 𝑩. Het element in rij 𝒊 en kolom 𝒋 van 𝑨𝑩 is de som van de producten van de bijbehorende

elementen uit rij 𝒊 van 𝑨 en kolom 𝒋 van 𝑩:

(𝐴𝐵)𝑖𝑗 = 𝑎𝑖1 𝑏1𝑗 + 𝑎𝑖2 𝑏2𝑗 + ⋯ + 𝑎𝑖𝑛 𝑏𝑛𝑗

Voorbeeld

2

3

4

3 6

𝐴=[

] en 𝐵 = [

]

1 −5

1 −2 3

2∙4+3∙1

2 ∙ 3 + 3 ∙ (−2)

𝐴𝐵 = [

1 ∙ 4 + (−5) ∙ 1 1 ∙ 3 + (−5) ∙ (−2)

2∙6+3∙3

11

]=[

1 ∙ 6 + (−5) ∙ 3

−1

0

13

21

]

−9

Bij het vermenigvuldigen van matrixen gelden de volgende algebraïsche eigenschappen:

𝐴(𝐵𝐶) = (𝐴𝐵)𝐶

𝑟(𝐴𝐵) = (𝑟𝐴)𝐵 = 𝐴(𝑟𝐵)

𝐴(𝐵 + 𝐶) = 𝐴𝐵 + 𝐴𝐶

𝐼𝑚 𝐴 = 𝐴 = 𝐴𝐼𝑛

(𝐵 + 𝐶)𝐴 = 𝐵𝐴 + 𝐶𝐴

Let hierbij op dat:

Over het algemeen geldt 𝐴𝐵 ≠ 𝐵𝐴

Wanneer 𝐴𝐵 = 𝐴𝐶 betekent dit niet dat 𝐵 = 𝐶

Wanneer 𝐴𝐵 een nulmatrix is, betekent dat niet per se dat 𝐴 = 0 of 𝐵 = 0

Een matrix tot een bepaalde macht verheffen doe je d.m.v. herhaald vermenigvuldigen:

𝐴𝑘 = ⏟

𝐴…𝐴

𝑘

Wanneer je de 𝑚 × 𝑛 matrix 𝐴 transponeert, krijg je de 𝑛 × 𝑚 matrix 𝐴𝑇 , wiens kolommen overeenkomen met

de rijen van 𝐴:

𝑎 𝑏

𝑎 𝑐 𝑒

𝐴 = [ 𝑐 𝑑]

→

𝐴𝑇 = [𝑏 𝑑 𝑓]

𝑒 𝑓

Voor het transponeren van matrixen gelden de volgende rekenregels:

(𝐴𝑇 )𝑇 = 𝐴

(𝐴 + 𝐵)𝑇 = 𝐴𝑇 + 𝐵𝑇

(𝑟𝐴)𝑇 = 𝑟𝐴𝑇

(𝐴𝐵)𝑇 = 𝐵𝑇 𝐴𝑇

2.2 DE INVERSE VAN EEN MATRIX

De inverse van matrix 𝐴 is de matrix 𝐴−1 waarvoor geldt:

𝐴−1 𝐴 = 𝐼 en 𝐴𝐴−1 = 𝐼

Niet alle matrices hebben een inverse. Wanneer een matrix niet inverteerbaar is, spreken we van een

SINGULIERE MATRIX. Alle niet-vierkante matrixen zijn singulier.

Voor de inverse een 2 × 2 matrix geldt:

1

1

𝑎 𝑏

𝑑 −𝑏

𝑑

𝐴=[

]

→

𝐴−1 =

[

]=

[

𝑎𝑑−𝑏𝑐 −𝑐

det 𝐴 −𝑐

𝑐 𝑑

𝑎

Hierin is 𝑎𝑑 − 𝑏𝑐 de determinant van 𝐴.

De matrix is inverteerbaar dan en slechts dan als det 𝐴 ≠ 0.

−𝑏

]

𝑎

De inverse van matrix 𝐴 kan worden gebruikt om een vergelijking in de vorm 𝐴𝒙 = 𝒃 op te lossen door beide

kanten met 𝐴−1 te vermenigvuldigen. Hieruit volgt:

𝒙 = 𝐴−1 𝒃

Voorbeeld

3𝑥1 + 4𝑥2 = 3

5𝑥1 + 6𝑥2 = 7

𝐴−1 =

1

3∙6−4∙5

[

→

6

−5

−3

−4

]=[ 5

3

2

3 4 𝑥1

3

3 4

[

] [ ] = [ ], waarin 𝐴 = [

]

5 6 𝑥2

7

5 6

𝑥1

2

−3

3

3

→

[ ] = 𝐴−1 [ ] = [ 5

− ]

𝑥2

7

2

2

2 3

5

3

− ] [7] = [−3]

2

Voor inversen gelden de volgende rekenregels:

Wanneer 𝐴 inverteerbaar is, dan is 𝐴−1 dat ook en geldt:

(𝐴−1 )−1 = 𝐴

Wanneer 𝐴 en 𝐵 beide inverteerbare 𝑛 × 𝑛 matrices zijn, dan is 𝐴𝐵 dat ook en geldt:

(𝐴𝐵)−1 = 𝐵 −1 𝐴−1

Wanneer 𝐴 inverteerbaar is, dan is 𝐴𝑇 dat ook en geldt:

(𝐴𝑇 )−1 = (𝐴−1 )𝑇

ELEMENTAIRE MATRIX: matrix die wordt verkregen door één enkele basis rijbewerking uit te voeren op de

identiteitsmatrix

Wanneer we een elementaire rijbewerking uitvoeren op 𝑚 × 𝑛 matrix 𝐴, dan kunnen we de resulterende

matrix schrijven als 𝐸𝐴, waarin de 𝑚 × 𝑚 matrix 𝐸 is gecreëerd d.m.v. dezelfde rijbewerking op 𝐼𝑚 .

Elke elementaire matrix 𝐸 is inverteerbaar. De inverse van 𝐸 is de elementaire matrix van hetzelfde type dat 𝐸

terugtransformeert naar 𝐼.

Een inverteerbare matrix is rij-equivalent met de identiteitsmatrix. We kunnen 𝐴−1 vinden d.m.v. de

rijreductie van 𝐴 tot 𝐼𝑛 , omdat de rijbewerkingen die hiervoor nodig zijn dezelfde rijbewerkingen zijn die 𝐼

reduceren tot 𝐴−1 . We voegen 𝐴 en 𝐼 samen tot de aangevulde matrix [𝐴 | 𝐼] en voeren rijbewerkingen uit

waardoor we uiteindelijk de aangevulde matrix [𝐼 | 𝐴−1 ] verkrijgen.

Voorbeeld

0

1 2

𝐴 = [1

0 3]

4 −3 8

0

1 2 1 0 0

1

0

3 0

[𝐴 | 𝐼] = [1

0 3 | 0 1 0] ~ [0

1

2| 1

4 −3 8 0 0 1

0 −3 −4 0

7 −3/2

1 0 0 −9/2

4

−1 ]

~ [0 1 0 | −2

3/2 −2

1/2

0 0 1

−9/2

7 −3/2

4

−1 ]

𝐴−1 = [ −2

3/2 −2

1/2

1

0

−4

0

1

0] ~ [0

1

0

0

1

0

3 0

2| 1

2 3

1

0

−4

0

0]

1

Het op deze manier bepalen van de inverse van matrix 𝐴 kan ook worden gezien als het gelijktijdig oplossen

van de systemen 𝐴𝒙 = 𝒆1 , 𝐴𝒙 = 𝒆2, ..., 𝐴𝒙 = 𝒆𝑛 d.m.v de aangevulde matrix [𝐴 | 𝒆1 𝒆2 … 𝒆𝑛 ] = [𝐴 | 𝐼].

2.3 KARAKTERISATIES VAN INVERTEERBARE MATRICES

Een lineaire transformatie 𝑇: ℝ𝑛 → ℝ𝑛 is inverteerbaar wanneer er een functie 𝑆: ℝ𝑛 → ℝ𝑛 bestaat zodanig

dat:

𝑆(𝑇(𝒙)) = 𝒙

en

𝑇(𝑆(𝒙)) = 𝒙

Dit is het geval dan en slechts dan als de standaard matrix van 𝑇, 𝐴, inverteerbaar is. Er geldt dan:

𝑆(𝒙) = 𝑇 −1 (𝒙) = 𝐴−1 𝒙

2.6 HET LEONTIEF INPUT-OUTPUT MODEL

De economie van een land is verdeeld in 𝑛 verschillende sectoren die goederen en diensten produceren. Voor

elke sector is de totale output en de verdeling hiervan over de overige factoren bekend. De productievector 𝒙

geeft voor elke sector de waarde (prijs) van de output weer. Deze output wordt verdeeld over de verschillende

(producerende) sectoren (INTERMEDIAIRE VRAAG), en de open sector, het deel van de economie dat enkel

consumeert en niets produceert (EINDVRAAG). Voor elke sector is er een EENHEID CONSUMPTIEVE VECTOR

(𝒄) die de input weergeeft die nodig is per eenheid output van de sector. Deze vectoren voor alle sectoren

samengevoegd leveren de CONSUMPTIEMATRIX 𝐶.

⏟

𝒙

=

𝐶𝒙

⏟

+

𝒅

⏟

, waarbij 𝐶 = [𝒄1 𝒄2 … 𝒄𝑛 ]

𝑝𝑟𝑜𝑑𝑢𝑐𝑡𝑖𝑒

𝑖𝑛𝑡𝑒𝑟𝑚𝑒𝑑𝑖𝑎𝑖𝑟𝑒 𝑣𝑟𝑎𝑎𝑔

𝑒𝑖𝑛𝑑𝑣𝑟𝑎𝑎𝑔

Herschrijven van de vergelijking 𝒙 = 𝐶𝒙 + 𝒅 levert de volgende uitdrukking voor 𝒙:

(𝐼 − 𝐶)𝒙 = 𝒅 →

𝒙 = 𝐶𝒙 + 𝒅

→

𝒙 = (𝐼 − 𝐶)−1 𝒅

I.p.v. de inverse van 𝐼 − 𝐶 te bepalen, kun je 𝒙 ook vinden d.m.v. rijbewerkingen in de aangevulde matrix van

(𝐼 − 𝐶)𝒙 = 𝒅 .

Voorbeeld

Voor een bepaalde economie geldt:

Input verbruikt per eenheid van output:

Aangeschaft door:

Industrie

Landbouw

Diensten

0,50

0,40

0,20

Industrie

0,20

0,30

0,10

Landbouw

0,10

0,10

0,30

Diensten

Verder is bekend dat de eindvraag van de industrie 50 eenheden is, die van de landbouw 30

eenheden, en die van de diensten 20 eenheden. Op basis hiervan kunnen 𝐶 en 𝒅 bepaald worden:

0,50 0,40 0,20

50

𝐶 = [0,20 0,30 0,10] en 𝒅 = [30]

0,10 0,10 0,30

20

0,50 −0,40 −0,20

𝐼 − 𝐶 = [−0,20

0,70 −0,10]

−0,10 −0,10

0,70

Hieruit volgt voor de aangevulde matrix van (𝐼 − 𝐶)𝒙 = 𝒅:

1

0 −2/3 4700/27

1 −0,80 −0,40 100

0,50 −0,40 −0,20 50

0,54 −0,18 | 50 ] ~ [ 0

[−0,20

0,70 −0,10 | 30] ~ [ 0

1 −1/3 | 2500/27]

0 −0,18

0,66 30

−0,10 −0,10

0,70 20

140/3

0

0

0,60

1

0

0 6100/27

226

~[ 0

→

𝒙 = [119]

1

0 | 3200/27]

700/9

0

0

1

78

Alle producerende sectoren zullen hun output afstemmen op de eindvraag: 𝒙 = 𝒅. Deze productie leidt tot een

intermediaire vraag 𝐶𝒅. Deze intermediaire vraag leidt tot een extra productie: 𝒙 = 𝒅 + 𝐶𝒅. De intermediaire

vraag behorende bij deze productie is niet 𝐶𝒅 maar 𝐶(𝒅 + 𝐶𝒅) = 𝐶𝒅 + 𝐶 2 𝒅. Aangezien de intermediaire

vraag is toegenomen met 𝐶 2 𝒅, moet ook de productie toenemen met 𝐶 2 𝒅: 𝒙 = 𝒅 + 𝐶𝒅 + 𝐶 2 𝒅. Enz.

Hieruit volgt:

𝒙 = 𝒅 + 𝐶𝒅 + 𝐶 2 𝒅 + ⋯ + 𝐶 𝑚 𝒅 = (𝐼 + 𝐶 + 𝐶 2 + ⋯ + 𝐶 𝑚 )𝒅

Aangezien 𝒙 = (𝐼 − 𝐶)−1 𝒅, volgt hieruit:

(𝐼 − 𝐶)−1 ≈ 𝐼 + 𝐶 + 𝐶 2 + ⋯ + 𝐶 𝑚

Deze formule geldt enkel als de som van elke kolom van 𝐶 kleiner is dan 1. Dit is over het algemeen het geval,

omdat er minder dan 1 eenheid aan input nodig is voor de productie van 1 eenheid aan output.

Vermenigvuldiging van deze uitdrukking van (𝐼 − 𝐶)−1 met (𝐼 − 𝐶) levert:

(𝐼 − 𝐶)(𝐼 + 𝐶 + 𝐶 2 + ⋯ + 𝐶 𝑚 ) = (𝐼 + 𝐶 + 𝐶 2 + ⋯ + 𝐶 𝑚 ) − (𝐶 + 𝐶 2 + 𝐶 3 + ⋯ + 𝐶 𝑚+1 ) = 𝐼 − 𝐶 𝑚+1

Aangezien alle kolommen van 𝐶 kleiner zijn dan 1, nadert 𝐶 𝑚 naar 0. Oftewel:

(𝐼 − 𝐶)(𝐼 + 𝐶 + 𝐶 2 + ⋯ + 𝐶 𝑚 ) ≈ 𝐼

2.8 DEELRUIMTES VAN ℝ𝑛

Een DEELRUIMTE van ℝ𝑛 is een verzameling 𝐻 in ℝ𝑛 met de volgende 3 eigenschappen:

De nulvector zit in 𝐻.

Voor elke 𝒖 en 𝒗 in 𝐻 zit ook de som 𝒖 + 𝒗 in 𝐻.

Voor elke 𝒖 in 𝐻 en elke scalair 𝑐 zit ook de vector 𝑐𝒖 in 𝐻.

Wanneer 𝒗1 , 𝒗2 , … , 𝒗𝑝 in ℝ𝑛 zitten, en 𝐻 = 𝑆𝑝𝑎𝑛{𝒗1 , 𝒗2 , … , 𝒗𝑝 }, dan is 𝐻 een deelruimte van ℝ𝑛 . Anders

gezegd, 𝑆𝑝𝑎𝑛{𝒗1 , 𝒗2 , … 𝒗𝑝 } is de deelruimte opgespannen door 𝒗1 , 𝒗2 , … , 𝒗𝑝 .

De KOLOMRUIMTE van een matrix 𝐴 is de verzameling 𝐶𝑜𝑙 𝐴 van alle lineaire combinaties van de kolommen

van 𝐴. Wanneer 𝐴 = [𝒂1 𝒂2 … 𝒂𝑛 ] en alle kommen in ℝ𝑚 zitten, dan geldt 𝐶𝑜𝑙 𝐴 = 𝑆𝑝𝑎𝑛{𝒂1 , 𝒂2 , … , 𝒂𝑛 }.

De kolomruimte van een 𝑚 × 𝑛 matrix is dus een deelruimte van ℝ𝑚 . Het is de verzameling van alle 𝒃

waarvoor het systeem 𝐴𝒙 = 𝒃 een oplossing heeft.

Voorbeeld

1 −3 −4

3

𝐴 = [−4

en

𝒃 = [ 3]

6 −2]

−3

7

6

−4

𝒃 zit in de kolomruimte van 𝐴 wanneer de vergelijking 𝐴𝒙 = 𝒃 een oplossing heeft. Dit kun je

bepalen d.m.v. rijreductie van de aangevulde matrix:

1 −3 −4

1 −3

−4

3

3

1

0

5 −9/2

[−4

6 −2 | 3 ] ~ [ 0 −6 −18 | 15] ~ [ 0

1

3 | −5/2]

−3

7

6 −4

0 −2 −6

5

0

0

0

0

𝐴𝒙 = 𝒃 is consistent, dus 𝒃 zit in 𝐶𝑜𝑙 𝐴.

De NULRUIMTE van matrix 𝐴 is de verzameling 𝑁𝑢𝑙 𝐴 van alle oplossingen van de homogene vergelijking 𝐴𝒙 =

𝟎. Wanneer 𝐴 een 𝑚 × 𝑛 matrix is, dan is de nulruimte van 𝐴 een deelverzameling van ℝ𝑛 .

Voorbeeld

−7

1 −1

5

𝐴=[ 2

en

𝒃 = [ 3]

0

7]

2

−3 −5 −3

𝒃 zit in de nulruimte van 𝐴 wanneer geldt 𝐴𝒃 = 𝟎.

1 ∙ (−7) + (−1) ∙ 3 + 5 ∙ 2

0

1 −1

5 −7

2 ∙ (−7) + 0 ∙ 3 + 7 ∙ 2

𝐴𝒃 = [ 2

] = [0] = 𝟎

0

7] [ 3] = [

(−3) ∙ (−7) + (−5) ∙ 3 + (−3) ∙ 2

2

0

−3 −5 −3

𝐴𝒃 = 𝟎, dus 𝑏 zit in 𝑁𝑢𝑙 𝐴.

Een BASIS voor een deelruimte 𝐻 van ℝ𝑛 is een lineaire onafhankelijke verzameling in 𝐻 die 𝐻 opspant. De

kolommen van een inverteerbare 𝑛 × 𝑛 matrix vormen een basis voor ℝ𝑛 , omdat ze lineair onafhankelijk zijn

en ℝ𝑛 opspannen. De verzameling {𝒆1 , 𝒆2 , … 𝒆𝑛 } noemen we de STANDAARDBASIS voor ℝ𝑛 .

Voorbeeld

−3

6 −1

1 −7

𝐴 = [ 1 −2

2

3 −1]

2 −4

5

8 −4

We zoeken een basis voor de nulruimte van 𝐴, oftewel een oplossing voor de homogene vergelijking 𝐴𝒙 =

𝟎. We vinden deze oplossing door rijreductie toe te passen op de aangevulde matrix:

1 −2

1/3 −1/3

7/3 0

−3

6 −1

1 −7 0

1 −2

0 −1

3 0

0

5/3 10/3 −10/3 | 0] ~ [ 0

[ 1 −2

2

3 −1 | 0] ~ [ 0

0

1

2 −2 | 0]

0

0 13/3 26/3 −26/3 0

2 −4

5

8 −4 0

0

0

0

0

0 0

𝑥1

2𝑥2 + 𝑥4 − 3𝑥5

2

1

−3

𝑥2

𝑥2

1

0

0

𝑥 = 𝑥3 = −2𝑥4 + 2𝑥5 = 𝑥2 0 + 𝑥4 −2 + 𝑥5 2 = 𝑥2 𝒖 + 𝑥4 𝒗 + 𝑥5 𝒘,

𝑥4

𝑥4

0

1

0

[𝑥5 ] [

[ 0]

[ 0]

[ 1]

𝑥5

]

2

1

−3

1

0

0

waarin 𝑢 = 0 , 𝑣 = −2 en 𝑤 = 2

0

1

0

[ 0]

[ 0]

[ 1]

Iedere combinatie van 𝒖, 𝒗 en 𝒘 levert een nulruimte van 𝐴. Oftewel: {𝒖, 𝒗, 𝒘} is een basis voor 𝑁𝑢𝑙 𝐴.

Voorbeeld

1

3

3

2 −9

1

0 −3

5

0

−2 −2

2 −8

2

0

1

2 −1

0

𝐵=[

] en

𝐴=[

] ~𝐵

2

3

0

7

1

0

0

0

0

1

3

4 −1

1 −8

0

0

0

0

0

We zoeken een basis voor de kolomruimte van 𝐵. Aangezien 𝒃3 en 𝒃4 lineaire combinaties zijn van de

andere kolommen, is elke combinatie van 𝒃1 , 𝒃2 , … , 𝒃5 eigenlijk een combinatie van 𝒃1 , 𝒃2 en 𝒃5 . Oftewel,

{𝒃1 , 𝒃2 , 𝒃5 } is een basis voor 𝐶𝑜𝑙 𝐵. Aangezien matrix 𝐴 rij-equivalent is met matrix 𝐵 moeten 𝒂3 en 𝒂4

lineaire combinaties zijn van 𝒂1 , 𝒂2 , … , 𝒂5 . Oftewel, {𝒂1 , 𝒂2 , 𝒂5 } is een basis voor 𝐶𝑜𝑙 𝐴.

Uit het bovenstaande voorbeeld volgt dat de pivotkolommen van een matrix 𝐴 de basis voor de kolomruimte

van 𝐴 vormen.

2.9 DIMENSIES EN RANG

Wanneer de verzameling 𝐵 = {𝒃1 , 𝒃2 , … , 𝒃𝑝 } de basis is voor een deelruimte 𝐻, dan zijn voor elke 𝒙 in 𝐻 de

coördinaten van 𝒙 t.o.v. 𝐵 de gewichten 𝑐1 , 𝑐2 , … , 𝑐𝑝 zodat 𝒙 = 𝑐1 𝒃1 + 𝑐2 𝒃2 + ⋯ + 𝑐𝑝 𝒃𝑝 . De onderstaande

vector noemen we de coördinatenvector van 𝒙 (t.o.v. 𝐵) of de 𝐵-coördinatenvector van 𝒙:

𝑐1

𝑐2

[𝒙]𝐵 = [ ⋮ ]

𝑐𝑝

Voorbeeld

3

3

−1

𝒗1 = [ 6], 𝒗2 = [ 0 ], 𝒙 = [ 12] en 𝐵 = {𝒗1 , 𝒗2 }

2

1

7

Aangezien 𝒗1 en 𝒗2 lineair onafhankelijk zijn, is 𝐵 een basis voor 𝐻 = 𝑆𝑝𝑎𝑛{𝒗1 , 𝒗2 }

𝑥 zit in 𝐻 wanneer de volgende vergelijking consistent is:

3

3

−1

𝑐1 [ 6] + 𝑐2 [ 0 ] = [ 12]

2

1

7

Dit levert de volgende aangevulde matrix:

1 −1/3

3

1

1

0

2

3 −1

2 | 6] ~ [ 0

[ 6

0 | 12] ~ [ 0

1 | 3]

0

5/3

2

1

7

5

0

0

0

De vergelijking 𝑐1 𝒗1 + 𝑐2 𝒗2 = 𝒙 is consistent, dus 𝒙 zit in 𝐻. Voor de coördinatenvector van 𝒙 geldt:

[𝒙]𝐵 = [2]

3

De DIMENSIE van een niet-nul deelruimte 𝐻 (dim 𝐻), is het aantal vectoren in elke basis van 𝐻. De dimensie

van de nuldeelruimte is 0.

De RANG van een matrix 𝐴 (𝑟𝑎𝑛𝑔 𝐴) is de dimensie van de kolomruimte van 𝐴.

RANG STELLING: als matrix 𝐴 𝑛 kolommen heeft, dan geldt: 𝑟𝑎𝑛𝑔 𝐴 + dim 𝑁𝑢𝑙 𝐴 = 𝑛

Deze stelling kan simpel beredeneerd worden, aangezien 𝑟𝑎𝑛𝑔 𝐴 het aantal pivotkolommen is, en dim 𝑁𝑢𝑙 𝐴

het aantal vrije variabelen.

BASISSTELLING: Wanneer 𝐻 een 𝑝-dimensionale deelruimte van ℝ𝑛 is, dan is elke lineair onafhankelijke

verzameling van precies 𝑝 elementen in 𝐻 automatisch een basis voor 𝐻. Ook geldt dat elke verzameling van 𝑝

elementen die 𝐻 opspant, automatisch een basis voor 𝐻 is.

2.3 KARAKTERISATIES VAN INVERTEERBARE MATRICES (VERVOLG)

Wanneer 𝐴 een vierkante 𝑛 × 𝑛 matrix is, dan zijn de volgende beweringen ofwel allemaal waar (inverteerbare

matrix), ofwel allemaal niet waar (singuliere matrix). De meeste beweringen slaan terug op hoofdstuk 1.

𝐴 is een inverteerbare matrix.

𝐴 is rij-equivalent aan de 𝑛 × 𝑛 identiteitsmatrix.

𝐴 heeft 𝑛 pivotposities.

De vergelijking 𝐴𝒙 = 𝟎 heeft enkel de triviale oplossing.

De kolommen van 𝐴 vormen een lineair onafhankelijke verzameling.

De lineaire transformatie 𝒙 ⟼ 𝐴𝒙 is injectief.

De vergelijking 𝐴𝒙 = 𝒃 heeft ten minste één oplossing voor elke 𝑏 in ℝ𝑛 .

De kolommen van 𝐴 spannen ℝ𝑛 op.

De lineaire transformatie 𝒙 ⟼ 𝐴𝒙 van ℝ𝑛 naar ℝ𝑛 is surjectief.

Er is een 𝑛 × 𝑛 matrix 𝐶 zodat 𝐶𝐴 = 𝐼.

Er is een 𝑛 × 𝑛 matrix 𝐷 zodat 𝐴𝐷 = 𝐼.

𝐴𝑇 is een inverteerbare matrix.

De kolommen van 𝐴 vormen een basis voor ℝ𝑛 .

𝐶𝑜𝑙 𝐴 = ℝ𝑛

dim 𝐶𝑜𝑙 𝐴 = 𝑛

𝑟𝑎𝑛𝑘 𝐴 = 𝑛

𝑁𝑢𝑙 𝐴 = {𝟎}

dim 𝑁𝑢𝑙 𝐴 = 0

HOOFDSTUK 3: DETERMINANTEN

3.1 INTRODUCTIE VAN DETERMINANTEN

ONDERMATRIX: de matrix 𝐴𝑖𝑗 is de ondermatrix van 𝐴 die ontstaat door de 𝑖 de rij en de 𝑗de kolom te

verwijderen

Voorbeeld

1

5

0

𝐴=[ 2

4 −1]

0 −2

0

4 −1

𝐴11 = [

]

−2

0

en

𝐴32 = [

1

2

0

]

−1

Een vierkante matrix is inverteerbaar dan en slechts dan als de determinant geen 0 is. In paragraaf 2.2 hebben

we al een uitdrukking voor de determinant van een 2 × 2 matrix gegeven.

Wanneer 𝑛 ≥ 2 geldt dat de determinant van een 𝑛 × 𝑛 matrix 𝐴 de som is van 𝑛 termen van de vorm

±𝑎1𝑗 det 𝐴𝑖𝑗 , waarbij het plus- en minteken elkaar afwisselen:

det 𝐴 = 𝑎11 det 𝐴11 − 𝑎12 det 𝐴12 + ⋯ + (−1)1+𝑛 𝑎1𝑛 det 𝐴1𝑛 = ∑𝑛𝑗=1(−1)1+𝑗 𝑎1𝑗 det 𝐴1𝑗

Voorbeeld

1

5

0

𝐴=[ 2

4 −1]

0 −2

0

4

det 𝐴 = 𝑎11 det 𝐴11 − 𝑎12 det 𝐴12 + 𝑎13 det 𝐴13 = 1 det [

−2

= 1(0 − 2) − 5(0 − 0) + 0(−4 − 0) = −2

−1

2

] − 5 det [

0

0

−1

2

] + 0 det [

0

0

4

]

−2

COFACTOR: de (𝑖, 𝑗)-cofactor van matrix 𝐴 = [𝑎𝑖𝑗 ] is het getal 𝐶𝑖𝑗 = (−1)𝑖+𝑗 det 𝐴𝑖𝑗

De bovenstaande definitie voor de determinant kan nu worden herschreven:

det 𝐴 = 𝑎11 𝐶11 + 𝑎12 𝐶12 + ⋯ + 𝑎1𝑛 𝐶1𝑛

In de bovenstaande definitie van de determinant is er sprake van een cofactorontwikkeling naar de 1 e rij. De

determinant van een 𝑛 × 𝑛 matrix 𝐴 kan echter worden berekend door een cofactorontwikkeling naar elke rij

of kolom. Voor de ontwikkeling naar de 𝑖 de rij geldt:

det 𝐴 = 𝑎𝑖1 𝐶𝑖1 + 𝑎𝑖2 𝐶𝑖2 + ⋯ + 𝑎𝑖𝑛 𝐶𝑖𝑛

Voor de ontwikkeling naar de 𝑗de kolom geldt:

det 𝐴 = 𝑎1𝑗 𝐶1𝑗 + 𝑎2𝑗 𝐶2𝑗 + ⋯ + 𝑎𝑛𝑗 𝐶𝑛𝑗

Om rekenwerk te besparen is het het slimst om een cofactorontwikkeling uit te voeren naar de rij of kolom met

de meeste nullen, omdat er dan heel veel termen wegvallen in de formule voor de determinant. Voor grote

matrices is het vaak nodig om meerdere cofactorontwikkelingen na elkaar uit te voeren. Je moet dan dus een

cofactorontwikkeling uitvoeren op één of meerdere van de ondermatrices.

Wanneer 𝐴 een driehoekige matrix is, dan is det 𝐴 het product van de elementen op de hoofddiagonaal van 𝐴.

Wanneer we de determinant van 𝐴 berekenen, kunnen dit noteren als |𝐴| i.p.v. det 𝐴.

3.2 EIGENSCHAPPEN VAN DETERMINANTEN

Wanneer 𝐴 een vierkante matrix is, dan gelden de volgende regels:

Wanneer matrix 𝐵 ontstaat door een veelvoud van een rij van 𝐴 bij een andere rij op te tellen, dan

geldt: det 𝐵 = det 𝐴

Wanneer matrix 𝐵 ontstaat door 2 rijen van 𝐴 te verwisselen, dan geldt: det 𝐵 = − det 𝐴

Wanneer matrix 𝐵 ontstaat door een rij van 𝐴 te vermenigvuldigen met 𝑘, dan geldt: det 𝐵 = 𝑘 det 𝐴

Uit deze regels volgt dat een matrix met lineair afhankelijke rijen een determinant heeft gelijk aan 0. Ook de

determinant van een matrix met lineair afhankelijke kolommen is 0.

Door de bovenstaande regels slim toe te passen, kun je jezelf een hoop werk besparen. De strategie is om 𝐴 te

reduceren tot de (standaard) rijvorm, omdat de determinant van een driehoekige matrix het product van de

elementen op de hoofddiagonaal is.

Voorbeeld

2 −8

6

3 −9

5

𝐴=[

−3

0

1

1 −4

0

2 −8

3 −9

det 𝐴 = |

−3

0

1 −4

1

0

= −2 |

0

0

8

10

]

−2

6

6

8

1 −4

5 10

3 −9

| = 2|

1 −2

−3

0

0

6

1 −4

−4

3

4

3 −4 −2

| = −2 |

0 −3

2

0 −6

2

1

0

0

0

3

4

1 −4

3

4

1 −4

5 10

0

3 −4 −2

0

3

| = 2|

| = 2|

1 −2

0 −12 10 10

0

0

0

6

0

0 −3

2

0

0

−4

3

4

3 −4 −2

| = −2 ∙ 1 ∙ 3 ∙ −3 ∙ −2 = −36

0 −3

2

0

0 −2

3

−4

−6

−3

Wanneer matrix 𝐴 rij-gereduceerd is tot de matrix 𝑈 in standaard rijvorm en er zijn 𝑟 rijwisselingen geweest,

dan geldt:

(−1)𝑟 ∙ (product van pivots in 𝑈)

als A inverteerbaar is

det 𝐴 = {

als A niet inverteerbaar is

0

I.p.v. rijbewerkingen kunnen we ook kolombewerkingen uitvoeren. Kolombewerkingen hebben hetzelfde effect

op determinanten als rijbewerkingen, omdat (voor een 𝑛 × 𝑛 matrix 𝐴) geldt:

det 𝐴𝑇 = det 𝐴

We gebruiken echter vrijwel altijd rijbewerkingen.

Wanneer 𝐴 en 𝐵 𝑛 × 𝑛 matrices zijn, dan geldt : det 𝐴𝐵 = (det 𝐴)(det 𝐵).

Stel, we hebben een 𝑛 × 𝑛 matrix 𝐴 waarvan we de 𝑗de kolom kunnen wijzigen: 𝐴 =

[𝒂1 … 𝒂𝑗−1 𝒙 𝒂𝑗+1 … 𝒂𝑛 ]

We kunnen de transformatie 𝑇 van ℝ𝑛 naar ℝ definiëren door:

𝑇(𝒙) = det[𝒂1 … 𝒂𝑗−1 𝒙 𝒂𝑗+1 … 𝒂𝑛 ]

Dit is een lineaire transformatie, omdat geldt:

𝑇(𝑐𝒙) = 𝑐𝑇(𝒙)

𝑇(𝒖 + 𝒗) = 𝑇(𝒖) + 𝑇(𝒗)

3.3 REGEL VAN CRAMER, VOLUME, EN LINEAIRE TRANSFORMATIES

Wanneer 𝑛 × 𝑛 matrix 𝐴 en 𝒃 in ℝ𝑛 zitten, dan is 𝐴𝑖 (𝒃) de matrix die wordt verkregen door in 𝐴 de 𝑖 de kolom

te vervangen door b:

𝐴𝑖 (𝒃) = [𝒂1 … 𝒃 … 𝒂𝑛 ]

REGEL VAN CRAMER: Voor elke 𝑏 is de unieke oplossing 𝑥 van 𝐴𝑥 = 𝑏 gelijk aan:

𝑥1 =

det 𝐴𝑖 (𝒃)

det 𝐴

𝑖 = 1, 2, … , 𝑛

Voorbeeld

3𝑥1 − 2𝑥2 = 6

−5𝑥1 + 4𝑥2 = 8

3 −2

𝐴=[

]

−5

4

6 −2

𝐴1 (𝒃) = [

]

8

4

3

6

𝐴2 (𝒃) = [

]

−5

8

det 𝐴1 (𝒃)

40

𝑥1 =

= = 20

𝑥2 =

det 𝐴

det 𝐴2 (𝒃)

det 𝐴

=

2

54

2

= 27

→

3 −2

6

[

]𝑥 = [ ]

−5

4

8

det 𝐴 = 12 − 10 = 2

→

det 𝐴1 (𝒃) = 24 − (−16) = 40

→

det 𝐴2 (𝒃) = 24 − (−30) = 54

→

4

−2

|

2

2

Op basis van de regel van Cramer kun je een nieuwe formule voor de inverse van een 𝑛 × 𝑛 matrix 𝐴 opstellen.

De 𝑗e kolom van 𝐴−1 is de vector 𝒙 die voldoet aan: 𝐴𝒙 = 𝒆𝑗 .

Toepassen van de regel van Cramer levert voor het element (𝑖, 𝑗) van 𝐴−1 : 𝑥𝑖 =

Een cofactorontwikkeling langs kolom 𝑖 van 𝐴𝑖 (𝑒𝑗 ) levert: det 𝐴𝑖 (𝒆𝑗 ) =

det 𝐴𝑖 (𝒆𝑗 )

(−1) 𝑗+𝑖

det 𝐴

.

det 𝐴𝑗𝑖 = 𝐶𝑗𝑖 .

𝐶𝑗𝑖

Hieruit volgt: 𝑥𝑖 =

.

det 𝐴

Dit is de uitdrukking voor 1 element, het element in de 𝑖 de rij en de 𝑗de kolom van 𝐴−1 . Voor 𝐴−1 geldt:

𝐶11 𝐶21 … 𝐶𝑛1

𝐶

𝐶22 … 𝐶𝑛2

1

1

𝐴−1 =

[ 12

]=

adj𝐴

det 𝐴

det 𝐴

⋮

⋮

⋮

𝐶13 𝐶23 … 𝐶𝑛𝑛

De matrix van cofactors noemen we de GEADJUNGEERDE.

Wanneer 𝐴 een 2 × 2 matrix is, dan is de oppervlakte van het parallellogram dat

wordt bepaald door de kolommen van 𝐴 gelijk aan |det 𝐴|. Voor een diagonale

matrix is dit makkelijk te begrijpen:

𝑎 0

|det [

]| = |𝑎𝑑|

0 𝑑

Aangezien de absolute waarde van de determinant niet verandert wanneer 2

kolommen verwisseld worden of wanneer een veelvoud van de ene kolom bij de

andere wordt opgeteld, kunnen we stellen dat deze regel ook geldt voor niet𝑎 0

diagonale matrices. De matrix [

] kunnen we op deze manier

0 𝑑

namelijk zodanig transformeren dat de kolommen grafisch gezien

een parallellogram vormen.

Wanneer de niet-nulvectoren 𝒖 en 𝒗 een parallellogram vormen,

dan is de oppervlakte hiervan gelijk aan de oppervlakte van het

parallellogram dat wordt bepaald door 𝒖 en 𝒗 + 𝑐𝒖. Dit kan

verklaard worden door te stellen dan 𝐿 een lijn is door 0 en 𝒖. 𝐿 + 𝒗 is dan een lijn door 𝒗 parallel aan 𝐿. Het

punt 𝒗 + 𝑐𝒖 ligt op deze lijn. Aangezien de punten 𝒗 en 𝒗 + 𝑐𝒖 dezelfde loodrechte afstand hebben tot 𝐿, is de

oppervlakte van beide parallellogrammen gelijk.

Voorbeeld

We willen de oppervlakte van het parallellogram met hoekpunten (3, 1), (6, 3), (7, 5) en (4, 3) weten. Hiertoe

moeten we eerst het parallellogram verplaatsen over (−3, −1) zodat één van de hoekpunten in de oorsprong ligt.

De nieuwe hoekpunten zijn nu (0, 0), (3, 2) , (4, 4) en (1, 2).

Voor de oppervlakte geldt:

3 1

𝑜𝑝𝑝 = |det [

]| = |6 − 2| = 4

2 2

Wanneer 𝐴 een 3 × 3 matrix is, dan is het volume van het parallellepipedum dat wordt bepaald door de

kolommen van 𝐴 gelijk aan |det 𝐴|.

Wanneer 𝑇: ℝ2 → ℝ2 een lineaire transformatie is, bepaald door een 2 × 2 matrix 𝐴, en 𝑆 een parallellogram

is in ℝ2 , dan geldt voor de oppervlakte van het parallellogram na transformatie:

𝑜𝑝𝑝 𝑇(𝑆) = |det 𝐴| ∙ 𝑜𝑝𝑝 𝑆

Wanneer 𝑇 bepaald wordt door een 3 × 3 matrix 𝐴, en 𝑆 een parallellepipedum is in ℝ3 , dan geldt voor de

inhoud van het parallellepipedum na transformatie:

𝑣𝑜𝑙 𝑇(𝑆) = |det 𝐴| ∙ 𝑣𝑜𝑙 𝑆

HOOFDSTUK 6: ORTHOGONALITEIT EN ZEER KLEINE VIERKANTJES

6.1 INPRODUCT, LENGTE EN ORTHOGONALITEIT

Wanneer 𝒖 en 𝒗 vectoren (𝑛 × 1 matrices) zijn in ℝ𝑛 , dan levert het matrixproduct 𝒖𝑇 𝒗 een 1 × 1 matrix,

oftewel een scalair. Dit noemen we het INPRODUCT van 𝒖 en 𝒗, vaak genoteerd als 𝒖 ∙ 𝒗. Hiervoor geldt:

𝑢1

𝑣1

𝑣1

𝑢2

𝑣2

𝑣2

𝒖 ∙ 𝒗 = [ ⋮ ] ∙ [ ⋮ ] = [𝑢1 𝑢2 … 𝑢𝑛 ] [ ⋮ ] = 𝑢1 𝑣1 + 𝑢2 𝑣2 + ⋯ + 𝑢𝑛 𝑣𝑛

𝑢𝑛

𝑣𝑛

𝑣𝑛

Voorbeeld

3

2

𝒖 = [−5] en 𝒗 = [ 2 ]

−1

−3

𝒖 ∙ 𝒗 = 𝒖𝑇 𝒗 = [ 2

−5

3

−1] [ 2 ] = 2 ∙ 3 + (−5) ∙ 2 + (−1) ∙ (−3) = −1

−3

Voor inproducten gelden de volgende algebraïsche eigenschappen:

𝒖∙𝒗 =𝒗∙𝒖

(𝒖 + 𝒗) ∙ 𝒘 = 𝒖 ∙ 𝒘 + 𝒗 ∙ 𝒘

(𝑐𝒖) ∙ 𝒗 = 𝑐(𝒖 ∙ 𝒗) = 𝒖 ∙ (𝑐𝒗)

𝒖∙𝒖≥0

(𝒖 ∙ 𝒖 = 0 dan en slechts dan als 𝒖 = 0)

De lengte van een vector 𝑣 (genoteerd als ‖𝑣‖) is als volgt gedefinieerd:

‖𝒗‖ = √𝒗 ∙ 𝒗 = √𝑣12 + 𝑣22 + ⋯ + 𝑣𝑛2 , oftewel ‖𝑣‖2 = 𝑣 ∙ 𝑣

Deze formule kan verklaard worden d.m.v. de stelling van Pythagoras (zie plaatje

hiernaast, waarin 𝒗 = (𝑎, 𝑏)).

Voor elke constante geldt: ‖𝑐𝒗‖ = |𝑐|‖𝒗‖

Een vector met lengte 1 noemen we een eenheidsvector. Wanneer we een niet-nulvector 𝒗 delen door zijn

1

lengte (oftewel, vermenigvuldigen met ‖𝒗‖), dan levert dat de eenheidsvector 𝒖 op. Deze heeft dezelfde

richting als 𝒗.

Voorbeeld

1

−2

𝒗=[ ]

2

0

‖𝒗‖ = √𝒗 ∙ 𝒗 = √12 + (−2)2 + 22 + 02 = √9 = 3

1/3

1

1

1 −2

−2/3

𝒖 = ‖𝒗‖ 𝒗 = [ ] = [

]

3

2

2/3

0

0

Wanneer 𝒖 en 𝒗 allebei in ℝ𝑛 zitten, dan geldt voor de afstand tussen 𝒖 en 𝒗:

𝑑𝑖𝑠𝑡(𝒖, 𝒗) = ‖𝒖 − 𝒗‖

De vectoren 𝑢 en 𝑣 staan loodrecht op elkaar als de afstand van 𝑢 naar 𝑣 gelijk is

aan de afstand van 𝑢 naar −𝑣. Ze zijn dan orthogonaal.

𝑑𝑖𝑠𝑡(𝒖, 𝒗)

=

𝑑𝑖𝑠𝑡(𝒖, −𝒗)

2

(𝑑𝑖𝑠𝑡(𝒖, 𝒗))

‖𝒖 − 𝒗‖2

(𝒖 − 𝒗) ∙ (𝒖 − 𝒗)

𝒖∙𝒖−𝒖∙𝒗−𝒗∙𝒖+𝒗∙𝒗

‖𝒖‖2 + ‖𝒗‖2 − 2𝒖 ∙ 𝒗

=

=

=

=

=

2

(𝑑𝑖𝑠𝑡(𝒖, −𝒗))

‖𝒖 + 𝒗‖2

(𝒖 + 𝒗) ∙ (𝒖 + 𝒗)

𝒖∙𝒖+𝒖∙𝒗+𝒗∙𝒖+𝒗∙𝒗

‖𝒖‖2 + ‖𝒗‖2 + 2𝒖 ∙ 𝒗

−2𝒖 ∙ 𝒗

=

2𝒖 ∙ 𝒗

Dit is enkel het geval als 𝒖 ∙ 𝒗 = 0.

Hieruit volgt de Pythagorasstelling: twee vectoren 𝒖 en 𝒗 zijn orthogonaal dan en slechts dan als ‖𝑢 + 𝑣‖2 =

‖𝑢‖2 + ‖𝑣‖2

Wanneer 𝒛 orthogonaal is tot elke vector in deelruimte 𝑊 van ℝ𝑛 , dan is 𝒛 orthogonaal tot 𝑊. De verzameling

van alle vectoren 𝒛 die orthogonaal zijn tot 𝑊 noemen we het orthogonale complement van 𝑊 en noteren we

als 𝑊 ⊥ .

Wanneer 𝐴 een 𝑚 × 𝑛 matrix is, dan is het orthogonale complement van de rijruimte van 𝐴 de nulruimte van 𝐴

en dan is het orthogonale complement van de kolomruimte van 𝐴 de nulruimte van 𝐴𝑇 :

(𝑅𝑖𝑗 𝐴)⊥ = 𝑁𝑢𝑙 𝐴

(𝐾𝑜𝑙 𝐴)⊥ = 𝑁𝑢𝑙 𝐴𝑇

en

Wanneer 𝑥 in de nulruimte van 𝐴 zit, dan moet 𝑥 orthogonaal zijn tot elke rij van 𝐴, aangezien geldt 𝐴𝒙 = 𝟎.

Aangezien de rijen van 𝐴 de rijruimte opspannen, is 𝒙 orthogonaal tot 𝑅𝑖𝑗 𝐴. Hieruit volgt: (𝑅𝑖𝑗 𝐴)⊥ = 𝑁𝑢𝑙 𝐴.

Deze bewerking is waar voor elke matrix, ook 𝐴𝑇 . Hieruit volgt: (𝐾𝑜𝑙 𝐴)⊥ = 𝑁𝑢𝑙 𝐴𝑇

Wanneer 𝒖 en 𝒗 niet-nulvectoren zijn in ℝ2 of ℝ3 , dan is er het volgende verband tussen hun inproduct en de

hoek 𝜃 tussen de 2 lijnsegmenten vanuit de oorsprong naar de punten 𝒖 en 𝒗:

𝒖 ∙ 𝒗 = ‖𝒖‖‖𝒗‖ cos 𝜃

STEWART 12.4: HET UITPRODUCT

Het UITPRODUCT 𝒂 × 𝒃 van 2 vectoren is een vector. Wanneer 𝒂 = (𝑎1 , 𝑎2 , 𝑎3 ) en 𝒃 = (𝑏1 , 𝑏2 , 𝑏3 ), dan geldt:

𝒆1 𝒆2 𝒆3

𝑎2 𝑏3 − 𝑎3 𝑏2

𝑎2 𝑎3

𝑎1 𝑎3

𝑎1 𝑎2

𝒂 × 𝒃 = [ 𝑎3 𝑏1 − 𝑎1 𝑏3 ] = |𝑏 𝑏 | 𝒆1 − |𝑏 𝑏 | 𝒆2 + |𝑏 𝑏 | 𝒆3 = |𝑎1 𝑎2 𝑎3 |

2

3

1

3

1

2

𝑏1 𝑏2 𝑏3

𝑎1 𝑏2 − 𝑎2 𝑏1

e

Hoewel de 1 rij in deze laatste matrix uit vectoren bestaat, wordt de determinant uitgerekend alsof het

getallen zouden zijn.

Voorbeeld

1

𝒖 = [2] en 𝑣

3

𝒆1

𝒖×𝒗 =|1

1

1

= [ 0]

1

𝒆2 𝒆3

2

2 3| =|

0

0 1

3

1

|𝒆 − |

1 1

1

3

1

|𝒆 + |

1 2

1

2

2

| 𝒆3 = 2𝒆1 − (−2)𝒆2 + (−2)𝒆3 = [ 2 ]

0

−2

De vector 𝒂 × 𝒃 is orthogonaal tot zowel 𝒂 als 𝒃. Dit kan bewezen worden door het inproduct van de vector

𝒂 × 𝒃 met de vector 𝒂 dan wel 𝒃 te bepalen, aangezien moet gelden (𝒂 × 𝒃 ) ∙ 𝒂 = (𝒂 × 𝒃 ) ∙ 𝒃 = 0:

𝑎1

𝑎2 𝑏3 − 𝑎3 𝑏2

(𝒂 × 𝒃 ) ∙ 𝒂 = [𝑎3 𝑏1 − 𝑎1 𝑏3 ] ∙ [𝑎2 ] = 𝑎1 𝑎2 𝑏3 − 𝑎1 𝑎3 𝑏2 + 𝑎2 𝑎3 𝑏1 − 𝑎1 𝑎2 𝑏3 + 𝑎1 𝑎3 𝑏2 − 𝑎2 𝑎3 𝑏1 = 0

𝑎3

𝑎1 𝑏2 − 𝑎2 𝑏1

De richting van 𝒂 × 𝒃 kun je bepalen d.m.v. de rechterhandregel. Wanneer je vingers zijn gebogen in de

richting van de rotatie van 𝒂 naar 𝒃, dan wijst je duim in de richting van 𝒂 × 𝒃.

Wanneer 𝜃 de hoek is tussen 𝑎 en 𝑏 (0 ≤ 𝜃 ≤ 𝜋), dan geldt voor de lengte van 𝒂 × 𝒃:

‖𝒂 × 𝒃‖ = ‖𝒂‖‖𝒃‖ sin 𝜃

Twee niet-nulvectoren 𝑎 en 𝑏 zijn parallel dan en slechts dan als 𝒂 × 𝒃 = 𝟎. Dit

volgt uit bovenstaande formule door 𝜃 = 0 in te vullen.

Op basis van dezelfde formule kan worden gesteld dat de lengte van het

uitproduct 𝒂 × 𝒃 gelijk is aan de oppervlakte van het parallelogram dat wordt

bepaald door 𝒂 en 𝒃.

Voorbeeld

We hebben 3 punten: 𝑃 = (1, 4, 6), 𝑄 = (−2, 5, −1) en 𝑅 = (1, −1, 1)

We zoeken een vector loodrecht op het vlak dat door deze punten loopt. We zoeken dus een vector

die loodrecht staat op zowel 𝑷𝑸 als 𝑷𝑹. Dit is vector 𝑷𝑸 × 𝑷𝑹.

−2 − 1

−3

1−1

0

𝑷𝑸 = [ 5 − 4 ] = [ 1 ] en

𝑷𝑹 = [−1 − 4] = [−5]

−1 − 6

−7

1−6

−5

𝒆1 𝒆2 𝒆3

1 −7

−3 −7

−3

1

1 −7| = |

𝑷𝑸 × 𝑷𝑹 = |−3

|𝒆 − |

|𝒆 + |

|𝒆

−5 −5 1

0 −5 2

0 −5 3

0 −5 −5

−40

−8

= −40𝒆1 − 15𝒆2 + 15𝒆3 = [−15] = [−3]

15

3

Voor uitproducten gelden de volgende rekenregels:

𝒂 × 𝒃 = −𝒃 × 𝒂

(𝑐𝒂) × 𝒃 = 𝑐(𝒂 × 𝒃) = 𝒂 × (𝑐𝒃)

𝒂 × (𝒃 + 𝒄) = 𝒂 × 𝒃 + 𝒂 × 𝒄

(𝒂 + 𝒃) × 𝒄 = 𝒂 × 𝒄 + 𝒃 × 𝒄

𝒂 ∙ (𝒃 × 𝒄) = (𝒂 × 𝒃) ∙ 𝒄

𝒂 × (𝒃 × 𝒄) = (𝒂 ∙ 𝒄)𝒃 − (𝒂 ∙ 𝒃)𝒄

Het product 𝒂 ∙ (𝒃 × 𝒄) noemen we het SCALAIRE TRIPPELPRODUCT. We kunnen dit schrijven als een

determinant:

𝑎1 𝑎2 𝑎3

𝒂 ∙ (𝒃 × 𝒄) = |𝑏1 𝑏2 𝑏3 |

𝑐1 𝑐2 𝑐3

Zoals in paragraaf 3.3 uitgelegd is, is deze determinant gelijk aan het volume van de parallellepipedum dat is

bepaald door de vectoren 𝒂, 𝒃 en 𝒄. Wanneer deze determinant gelijk is aan 0, betekent dat dus dat het

volume van het parallellepipedum 0 is, en dus dat de vectoren in hetzelfde

vlak liggen.

Een toepassing van het uitproduct is het bepalen van het moment. Het

moment is namelijk als volgt gedefinieerd:

𝑴 = 𝒓 × 𝑭, waarin 𝑭 staat voor een kracht en 𝒓 voor de arm van deze

kracht.

Voor de grote van deze vector geldt:

‖𝑴‖ = ‖𝒓 × 𝑭‖ = ‖𝒓‖‖𝑭‖ sin 𝜃